Deepfake Video Of Rashmika Mandanna Deep Faux Abraham Lincoln Benito Mussolini Stalin

Deepfake Video: सोशल मीडिया पर इस समय डीपफेक टेक्नोलॉजी को लेकर हो रही बहस छिड़ी हुई है. यह बहस एक्ट्रेस रश्मिका मंदाना के वीडियो वायरल होने के बाद शुरू हुई. हाल ही में रश्मिका मंदाना का एक वीडियो सामने आया था. वीडियो में कि लिफ्ट का दरवाजा खुलता है और एक्ट्रेस रश्मिका मंदाना हंसते हुए लिफ्ट में एंटर करती हैं. हालांकि, यह वीडियो फेक है.

इस वीडियो में रश्मिका मंदाना नहीं, बल्कि कोई और ही लड़की है.इस लड़की को डीपफेक टेक्नोलॉजी से रश्मिका मंदाना में बदल दिया गया है. इस वीडियो के वायरल होने के बाद भारत में डीपफेक से निपटने के लिए एक लीगल रेगूलेरेटरी फ्रेम वर्क बनाने की मांग खड़ी हो गई. अमिताभ बच्चन ने भी एक्ट्रेस के इस फेक वीडियो के बाद मामले में कानूनी एक्शन लेने की बात कही है.

वैसे यह पहला मौका नहीं है, जब किसी डीपफेक वीडियो सामने आया हो, इससे पहले भी कई बार इस तरह के वीडियो सामने आ चुके हैं. डीपफेक टेक्नोलॉजी की शुरुआत फोटो में जोड़तोड़ से शुरू हुई. 1860 में दक्षिणी राजनीतिज्ञ जॉन कैलहौन की शरीर पर पर अब्राहम लिंकन का सर लगा दिया गया था और ये उनकी आइकॉनिक फोटो बन गई थी.

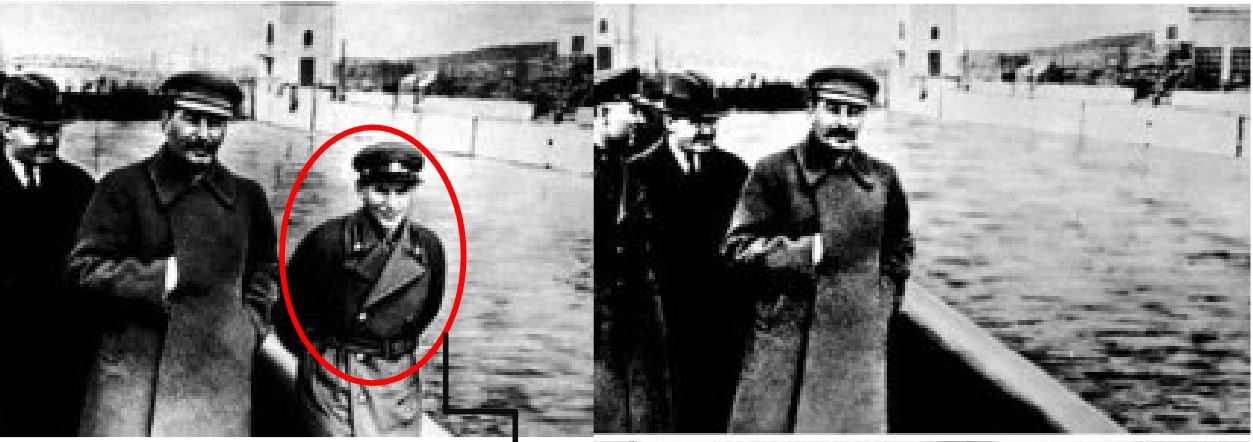

1930 में सोवियत लीडर स्टालिन की एक फेमस तस्वीर से कम्यूनिस्ट लिडर लियोन ट्रॉट्स्की को गायब कर दिया गया था, ताकि प्रोपगैंडा खड़ा किया जा सके.

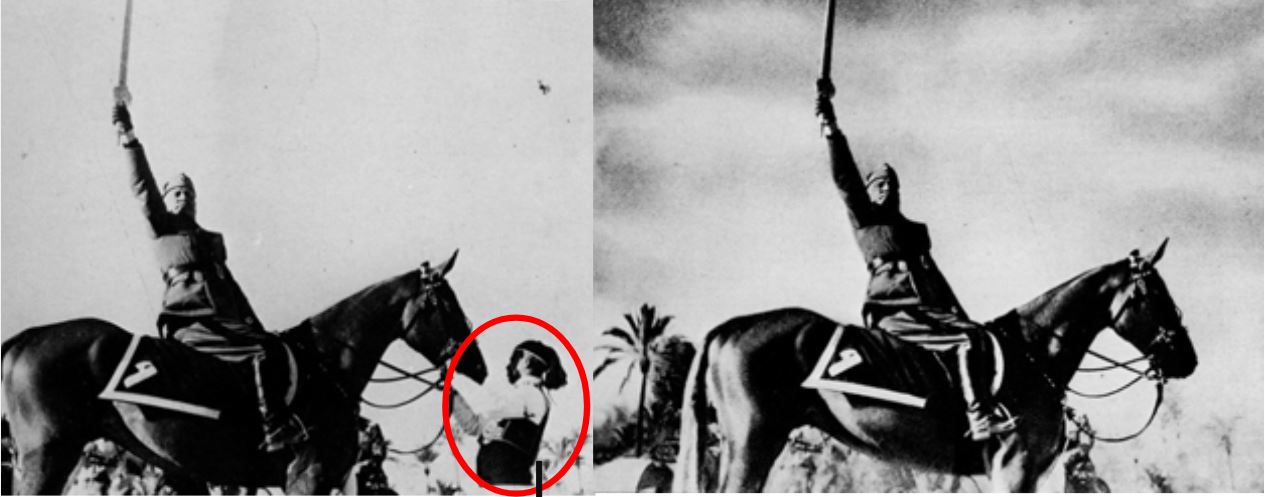

इसके अलावा डीपफेक तकनीक से बेनिटो मुसोलिनी की तस्वरी से घोड़ा पकड़ने वाले को बाहर कर दिया गया था, ताकि किसी को ये न लगे कि मुसोलिनी घोड़ा तक नहीं संभाल सकते.

1982 में नेशनल ग्राफिक्स मैगजीन के कवर पर गॉर्डन गैलेन ने गीजा के पिरामिड की तस्वीर ली थी, जिसको मैगजीन के कवर पर लगाना था. तस्वीर को कवर पर फिट करने के लिए दोनों पिरामिड्स को काफी नजदीक दिखाया गया था. इस पर इतना बवाल मचा कि मैगजीन को माफी मांगनी पड़ी थी.

यही नहीं साल 2014 में भी सौविद दत्ता फोटो स्केंडल भी काफी लाइमलाइट में आया था. दरअसल, उन्होंने कोलकत्ता में ली गई अपनी एक फोटो में मौजूद औरत के फेस को मैरी एलेन मार्क (एक फोटोग्राफर) द्वारा ली गई एक फोटो से बदल दिया था. पकड़े जाने पर उन्होंने अपनी गलती भी मानी.

क्या है डीपफेक?

साल 2017 में पहली बार डीपफेक शब्द का इस्तेमाल उन फोटो और वीडियो के लिए किया गया था, जो डीप लर्निंग टेक्निक के जरिए जेनरेट की गई थी. शुरूआत में डीपफेक का ज्यादातर इस्तेमाल पोर्नोग्राफी इमेज और वीडियो के लिए होता था. सितंबर 2019 में एआई फर्म डीपट्रेस (AI agency Deeptrace) ने इंटरनेट पर मौजूद 15,000 डीपफेक वीडियो का पता लगाया था, जिसमें 96 फीसदी वीडियो पोर्नोग्राफी से जुड़े हुए थे.

इनमें से 99 फीसदी वीडियो में फीमेल सेलिब्रेटीज के चेहरे को मोर्फ करके क्रिएट किया गया था. यानी इस टेक्नोलॉजी के जरिए औरतों को सबसे ज्यादा टार्गेट किया जाता है, लेकिन अब सवाल ये उठता है कि ये डीपफेक टेक्नोलॉजी आखिर काम कैसे करती है.

कैसे काम करती है डीपफेक तकनीक?

डीपफेक एआई आर्टिफिशियल इंटेलिजेंस का इस्तेमाल कर किसी दूसरे शख्स की कनविंसिंग इमेज, ऑडियो और वीडियो क्रिएट करने का काम करती है. डीपफेक दो एल्गोरिदम की मदद से ये काम करता है, जिसमें पहला जेनरेटर और दूसरा डिस्क्रिमिनेटर. जेनरेटर का काम फेम कंटेंट बनाना होता है और डिस्क्रिमिनेटर का काम ये देखना होता है कि यह फेक कंटेंट कितना असली लग रहा है.

यानी जब तक फेक फोटो या वीडियो असली जैसी नहीं लगने लग जाती डिस्क्रिमिनेटर उसे ठीक करवाता रहता है. इसी जेनरेटर और डिस्क्रिमिनेटर एल्गोरिदम की जोड़ी को जनरेटिव प्रतिकूल नेटवर्क कहा जाता है. यह डीप लर्निंग का इस्तेमाल कर फेक कंटेंट जेनरेट करता है.

कैसे बनाई जाती है डीपफेक वीडियो?

डीपफेक वीडियो दो तरह से बनाई जाती हैं. पहला जिस शख्स की फेक वीडियो बनानी है,उसके वास्तविक वीडियो को लेकर उसके फेस एक्सप्रेशन और बॉडी लैंगवेज को रीड कर उसका एक ऐसा वीडियो क्रिएट कर दिया जाता है, जिससे यह लगता है कि वो शख्स खुद ही सब कर रहा है या बोल रहा है.

वहीं, दूसरा तरीका फेस स्वेप का होता है. इसमें किसी शख्स का वीडियो रिकॉर्ड कर उसके ऊपर उस सेलेब्रिटी का चेहरा लग दिया जाता है, जिसका फेक वीडियो बनाना होता है. एक्ट्रेस रश्मिका मंदाना के मामले में इसी फेस स्वेप टेक्नोलॉजी का इस्तेमाल किया गया है.

वीडियो के अलावा ऑडियो भी डीपफेक होते हैं, जिसके लिए सिस्टम किसी सेलेब्रिटी की आवाज के सेंपल से ही उसकी आवाज क्रिएट कर लेता है.

रूस-यूक्रेन युद्ध के दौरान डीपफेक वीडियो

रूस-यूक्रेन युद्ध के दौरान टेलीग्राम चैनल पर यूक्रेन के राष्ट्रपति वलोडिमिर जेलेंस्की का एक डीपफेक वीडियो सर्कुलेट हुआ था, जिसमें वो अपनी सेना को सरेंडर करने के लिए कह रहे हैं. युद्ध की स्थिति में किसी देश का नेता अगर अपनी सेना को सरेंडर करने के लिए कह दे और वो डीपफेक एआई के जरिए बना वीडियो हो और लोग उसे सच मान लें तो किसी देश के डिफेंस के लिए वो कितना खतरनाक हो सकता है.

मार्क जुकरबर्ग का डीपफेक वीडियो

फेसबुक के फाउंडर मार्क जुकरबर्ग का भी एक डीपफेक वीडियो सामने आया था, जिसमें वह यह कहते नजर आ रहे हैं कि वह अरब के लोगों के चोरी किए डेटा को कंट्रोल करते हैं. ऐसे वीडियो से बड़े-बड़े बिजनेस रातों-रात तबाह हो सकते हैं और उनकी इंटेग्रिटी पर सवाल खड़े हो सकते है. यही नहीं इससे उस कंपनी के स्टॉक प्राइज भी प्रभावित हो सकता है.

इलेक्शन के दौरान विरोधी पार्टियों के नेताओं के फेक वीडियो सर्कुलेट किए जाते हैं, जिससे वोटर्स को उनके खिलाफ कर दिया जाता है और इलेक्शन के परिणामों को प्रभाविता किया जाता है. अमेरिकन प्रेसिडेंट जो बाइडेन भी यही कह रहे हैं. डीपफेक के जरिए लोगों की सेंसिटिव इन्फोर्मेशन जैसे कि बैंक अकाउंट, क्रेडिट कार्ड नंबर पता कर उनके साथ बैंक फ्रॉड भी किया जा सकता है.

यही नहीं डीपफेक के जरिए किसी देश की विदेश नीति को भी प्रभावित किया जा सकता है. जैसे हाल ही में रूस के राष्ट्रपति पुतिन का एक डीपफेक वीडियो सर्कुलेट किया गया था, जिसमें वह अमेरिकन डेमोक्रेसी पर हमला कर रहे थे.

डीपफेक का क्या प्रभाव पड़ेगा?

इतना ही नहीं डीपफेक के जरिए एक जीरो ट्रस्ट सोसायटी भी खड़ी की जा रही है, जिससे आने वाले समय में लोग डीपफेक के चंगुल में ऐसे फंस जाएंगे कि उन्हें पता ही नहीं चलेगा कि क्या सच है या क्या झूठ. जिस तरह से टेक्नोलॉजिकल एडवांसमेंट हो रही है ये पता लागाना भी मुश्किल होगा कि वीडियो असली है या नकली.

एक वक्त था जब डीपफेक वीडियो बनाने के लिए एक्सपर्ट की जरूरत होती थी, लेकिन अब मार्केट में कई ऐप और वेबसाइट्स आ चुकी हैं, जिससे एक आम शख्स भी डीपफेक वीडियो बना सकता है.

ये भी पढ़ें: Aditya-L1 Mission: आदित्य-एल1 के पेलोड HEL1OS ने सौर सोलर फ्लेयर्स की पहली हाई एनर्जी एक्सरे झलक की कैद